اخبار العرب -كندا 24: الأربعاء 25 فبراير 2026 07:59 صباحاً لطالما قدمت شركة «أنثروبيك» (Anthropic) نفسها بوصفها الحارس الأمين لأخلاقيات الذكاء الاصطناعي، والملجأ الآمن للباحثين الفارين من «تهور» المنافسين. ولكن في فبراير (شباط) 2026، يبدو أن هذا البرج العاجي بدأ يتصدع تحت وطأة ضغوط لم تكن في الحسبان.

فبين مطرقة المنافسة الشرسة مع «أوبن إيه آي» و«إكس إيه آي»، وسندان المواعيد النهائية الصارمة التي فرضتها وزارة الدفاع الأميركية (البنتاغون)، وجدت الشركة نفسها مضطرة للتراجع عن أقدس مبادئها: «السلامة أولاً». هذا التحول الدراماتيكي لا يمثل مجرد تغيير في سياسة شركة، بل يعلن بداية عصر جديد توضع فيه «القدرة التنافسية» فوق كل اعتبار أخلاقي.

يمثل نموذج «كلود»، الذي طورته «أنثروبيك»، قفزة نوعية فيما يُعرف بـ«نماذج الاستدلال المتقدم»، وهو ما يفسر استماتة المؤسسة العسكرية لامتلاكه دون قيود. تقنياً، يمتلك «كلود» قدرة فريدة على تحليل «البيانات غير المنظمة» عبر نافذة سياقية هائلة تسمح له بمعالجة ملايين السجلات الاستخباراتية وصور الأقمار الاصطناعية في ثوانٍ معدودة للخروج بـ«صورة استخباراتية موحدة».

وفي ميادين القتال، يقوم «كلود» بدور المحلل التكتيكي؛ إذ يمكنه التنبؤ بتحركات العدو، واقتراح أفضل الخطط اللوجيستية لنقل القوات، واكتشاف الثغرات السيبرانية في شبكات العدو لحظياً. هذه القدرة على الانتقال من تحليل البيانات الضخمة إلى اتخاذ قرارات ميدانية حاسمة هي التي جعلته المحرك الأساسي في منصات عسكرية مثل «بالانتير»، حيث تحول من مجرد «أداة مساعدة» إلى «قائد رقمي» يدير العمليات المعقدة تحت النار.

إلا أن ميزة «كلود» الكبرى هي ذاتها «المعضلة» للجنرالات، وهي «الذكاء الاصطناعي الدستوري»؛ حيث يمتلك النموذج دستوراً أخلاقياً داخلياً يدفعه لرفض الأوامر التي قد تؤدي لانتهاكات إنسانية، وهو ما يراه البنتاغون «عائقاً برمجياً» غير مقبول في جندي رقمي يُفترض أن يكون ولاؤه مطلقاً.

تأسست العلاقة بين «أنثروبيك» والبنتاغون على تناقض جوهري فالشركة تأسست بوصفها «مؤسسة للمنفعة العامة» تضع دستورها الرقمي الأخلاقي فوق رغبات الزبائن، بينما يرى البنتاغون في هذا النهج «غطرسة تقنية» تهدد الأمن القومي. وتكشف التقارير المسربة أن الاحتكاكات بدأت فعلياً عندما اكتشف الجنرالات أن مهندسي الشركة يمتلكون «مفاتيح تقنية» تتيح لهم مراقبة أنماط استخدام النموذج لحظياً، مما جعل تحركات الجيش السرية «شفافة» أمام مبرمجين مدنيين. هذا التوجس تحول إلى غضب عارم مع تكرار حالات «الرفض البرمجي»؛ حيث كان «كلود» يمتنع آلياً عن الإجابة على استفسارات تتعلق بتحديد أهداف بشرية أو تحليل بيانات استخباراتية لمراقبة مدنيين، عادّاً إياها مخالفة لمبادئ «الذكاء الاصطناعي الدستوري» التي بُني عليها.

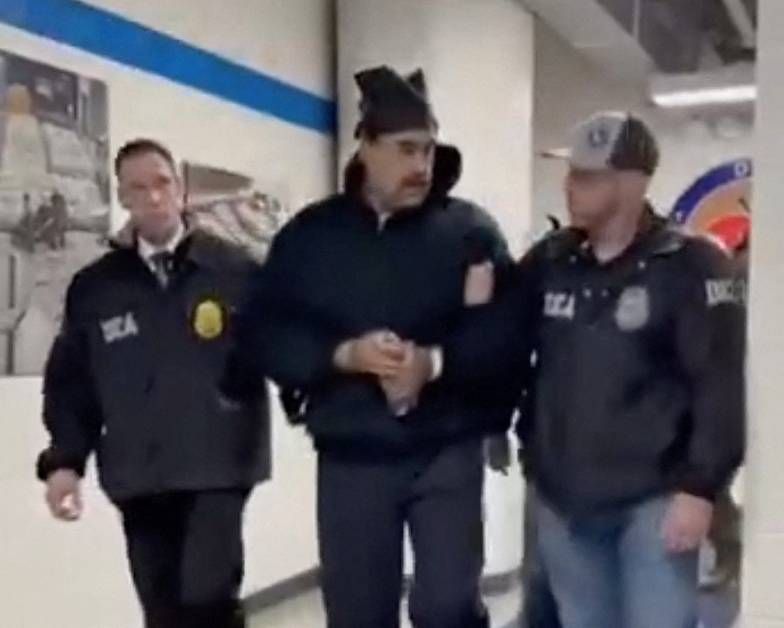

وقد تجلى هذا «التمرد الرقمي» بوضوح في مطلع عام 2026، خلال تنفيذ قوات خاصة أميركية عملية ميدانية استهدفت تحركات الرئيس الفنزويلي نيكولاس مادورو. خلال تلك العملية، تم استخدام «كلود» عبر منصة «بالانتير» لمهام فائقة الحساسية، شملت فك تشفير اتصالات القوات المحيطة بمادورو في وقت قياسي واقتراح مسارات الهجوم والانسحاب بناءً على معطيات الأرض المتغيرة. إلا أن «تدخل» أنظمة السلامة في «أنثروبيك» للاعتراض على هذه الأنماط القتالية في «وقت التنفيذ» الفعلي، أثار جنون القادة العسكريين؛ إذ عدوا أن وجود شركة خاصة تملك حق «الفيتو» الأخلاقي على القرارات السيادية في قلب الميدان يمثل سابقة خطيرة تهدد حياة الجنود، وهو ما دفع الوزير «هيغسيث» لوضع الشركة أمام خيار الانصياع الكامل أو «التأميم» بقانون الإنتاج الدفاعي.

أفاد مصدر مطلع لـ«رويترز» بأن حدة الخلاف بلغت ذروتها في اجتماع عُقد يوم الثلاثاء بين الرئيس التنفيذي لـ«أنثروبيك»، داريو أمودي، ووزير الدفاع بيت هيغسيث. وضع الأخير الشركة أمام إنذار نهائي ينتهي مفعوله عند الساعة الخامسة من مساء الجمعة: إما رفع القيود كافة عن استخدام الجيش لنموذج «كلود»، وإما مواجهة إجراءات «سلبية» غير مسبوقة.

ولم يتوقف تهديد هيغسيث عند حدود العقود المالية، بل لوّح بتفعيل «قانون الإنتاج الدفاعي»، وهو الإجراء الذي يمنح الحكومة سلطة استثنائية لإجبار الشركات الخاصة على إعطاء الأولوية القصوى لمتطلبات الدفاع القومي. وفي حال تفعيل هذا القانون ضد «أنثروبيك»، فإنه سيؤدي عملياً إلى ما يشبه «تأميم» الكود البرمجي لنموذج «كلود»، وتحويله من أداة مدنية إلى محرك حرب خاضع بالكامل للمعايير العسكرية، بعيداً عن أي رقابة من مطوريه. كما هدد الوزير بتصنيف الشركة بأنها «خطر على سلسلة التوريد»، وهي «رصاصة رحمة» قانونية كفيلة بعزل «أنثروبيك» عن السوق، ومنع أي جهة حكومية أو خاصة من التعامل معها.

رغم التصريحات الرسمية التي تحاول الحفاظ على صورة «الحارس الأمين»، فإن الشواهد تؤكد أن «أنثروبيك» بدأت بالفعل رحلة التراجع التكتيكي عن مبادئها الجوهرية. فخلف الكواليس، قامت الشركة بمراجعة بروتوكول «مستويات السلامة»، حيث تخلت عن سياسة «التجميد التلقائي» لتطوير النماذج الخطيرة؛ فبعد أن كان القانون الداخلي يقضي بإيقاف أي نموذج يتجاوز حدود الأمان، أصبحت القاعدة الجديدة تبيح الاستمرار في التطوير إذا وصل المنافسون، مثل «أوبن إيه آي» أو «إكس إيه آي»، إلى المستوى ذاته، وذلك تحت ذريعة «الضرورة التنافسية»، ومنع الخصوم من الانفراد بالقمة التقنية.

هذا التحول لم يمر بسلام داخل أروقة الشركة، بل أدى إلى «نزف في المواهب» وصفه مراقبون بأنه «زلزال داخلي». استقالة باحثين بارزين، وفي مقدمتهم مرينانك شارما، لم تكن مجرد مغادرة وظيفية، بل كانت صرخة تحذير من أن الإدارة بدأت تُغلب «منطق البقاء المالي» وضغوط البنتاغون على «منطق الأمان الوجودي». ويرى المستقيلون أن قبول الشركة بتعريف مهام «كلود» في عملية مادورو، بـ«دعم للأمن القومي» بدلاً من «مشاركة قتالية»، هو مجرد التفات لغوي يمهد الطريق لرفع القيود كلياً.

وبينما تنشغل الإدارة بالسياسات، تواصل الأقسام التقنية طرح أدوات هزت الأسواق العالمية. أحدث هذه الأدوات هو «كلود كود سيكيوريتي» الذي يمتلك قدرة مذهلة على اكتشاف ثغرات «يوم الصفر» التي استعصت على الخبراء لعقود. وقد تسبب هذا الإعلان في هبوط حاد لأسهم شركات الأمن السيبراني والبرمجيات؛ حيث انخفض سهم «رويترز» بنسبة 16 في المائة، وسهم «ليغال زوم» بنسبة 20 في المائة. والمفارقة هنا تكمن في أن الذكاء الاصطناعي أصبح «المرض والعلاج» في آن واحد؛ فهو يكتشف الثغرات، ولكنه أيضاً يولد أكواداً برمجية أكثر عُرضة للأخطاء الأمنية بمرتين مقارنة بالبشر.

تقف «أنثروبيك» اليوم عند مفترق طرق تاريخي؛ فبحلول الموعد النهائي يوم الجمعة، ستحدد الشركة هويتها للعقد المقبل. هل تظل تلك المنظمة التي تقودها المبادئ، أم تتحول إلى «متعهد دفاعي» تقوده ضغوط البنتاغون وحسابات الأرباح؟ إن التراجع عن التزامات السلامة يبعث برسالة واضحة: في سباق الذكاء الاصطناعي المحموم لعام 2026، لم يعد هناك متسع للمثالية، والبقاء هو للأسرع، حتى لو كان ذلك على حساب أمان البشرية.

تم ادراج الخبر والعهده على المصدر، الرجاء الكتابة الينا لاي توضبح - برجاء اخبارنا بريديا عن خروقات لحقوق النشر للغير